大数据培训:Spark Streaming核心原理

作者:张老师 浏览次数: 2020-11-30 17:04

我们都知道,Spark框架在大数据生态当中,是提供离线批处理,同时也支持准实时流处理的一个框架。这对于企业级的数据平台开发建设来说,是非常切合实际的一种选择,低成本,满足多需求数据处理。今天的大数据培训分享,我们就来讲讲Spark Streaming核心原理。

Spark Streaming,我们常常指称其为流处理组件,但是从本质上来说,Spark Streaming是Spark核心API的一个扩展,支持多数据源接入,具备高吞吐量、容错机制完善,数据处理之后在输出到外部文件系统。

Spark Streaming简介

作为spark的五大核心组件之一,spark Streaming原生地支持多种数据源的接入,而且可以与Spark MLLib、Graphx结合起来使用。数据可以从Kafka、flume、Twitter、zeroMQ、Kinesis或者TCP的端口引入,同时能够被类似于使用map、reduce、join和window这种高级函数的算法所处理,最终,被处理过的数据能够被推送到磁盘、数据库。

简而言之,Spark Streaming的作用就是实时的将不同的数据源的数据经过处理之后将结果输出到外部文件系统。

Spark Streaming工作原理

从粗粒度来说,Spark Streaming接收到实时数据流,把数据按照指定的时间段切成一片片小的数据块,然后把小的数据块传给Spark Engine处理。

从细粒度来说,Spark Streaming接收实时输入数据流,然后将数据拆分成多个batch,比如每收集1秒的数据封装为一个batch,然后将每个batch交给Spark的计算引擎进行处理,最后会生产出一个结果数据流,其中的数据,也是由一个一个的batch所组成的。

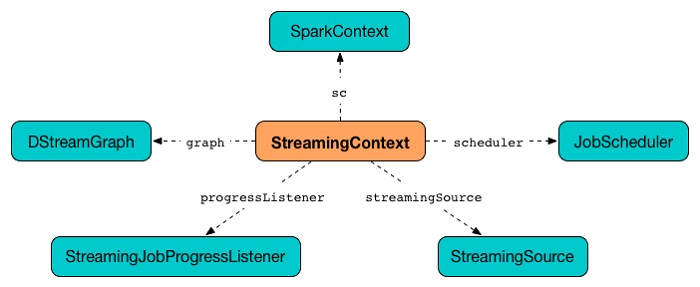

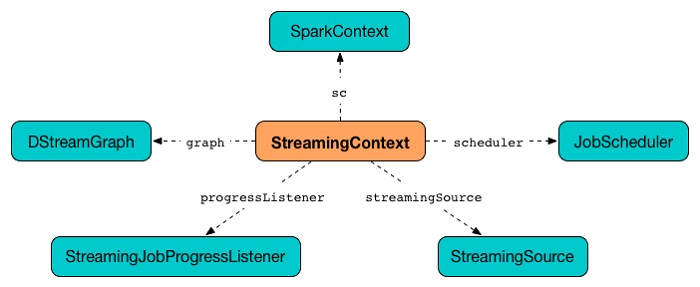

Spark Streaming运行机制

Spark Streaming提供了一种高级的抽象,叫做DStream,它代表了一个持续不断的数据流。DStream可以通过输入数据源来创建,比如Kafka、Flume、ZMQ和Kinesis;也可以通过对其他DStream应用高阶函数来创建,比如map、reduce、join、window。

DStream的内部,其实是一系列持续不断产生的RDD。RDD是Spark Core的核心抽象,即不可变的,分布式的数据集。DStream中的每个RDD都包含了一个时间段内的数据。

对DStream应用的算子,比如map,其实在底层会被翻译为对DStream中每个RDD的操作。比如对一个DStream执行一个map操作,会产生一个新的DStream。但是,在底层,其实其原理为,对输入DStream中每个时间段的RDD,都应用一遍map操作,然后生成的新的RDD,即作为新的DStream中的那个时间段的一个RDD。

底层的RDD的transformation操作,还是由Spark Core的计算引擎来实现的。Spark Streaming对Spark Core进行了一层封装,隐藏了细节,然后对开发人员提供了方便易用的高层次的API。

Spark Streaming算子关系:

1) Spark Streaming 算子分为Transformation和Output

2) Transformation包括Spark中的Transform和部分的Action(Reduce、Count等)

3) Output:

• Print

• saveAsObjectFile、saveAsTextFile、saveAsHadoopFiles:将一批数据输出到Hadoop文件系统中,用批量数据的开始时间戳来命名

• forEachRDD:允许用户对DStream的每一批量数据对应的RDD本身做任意操作

关于大数据培训,Spark Streaming核心原理,以上就为大家做了简单的介绍了。Spark Streaming在企业级数据处理上的表现,至今仍然值得称赞,也是大数据开发者们需要去搞清楚弄明白的重要框架组件。成都加米谷大数据,专业大数据培训机构,大数据开发,数据分析与挖掘,本月正在招生中,课程大纲及试学视频,可联系客服领取!

Spark Streaming,我们常常指称其为流处理组件,但是从本质上来说,Spark Streaming是Spark核心API的一个扩展,支持多数据源接入,具备高吞吐量、容错机制完善,数据处理之后在输出到外部文件系统。

Spark Streaming简介

作为spark的五大核心组件之一,spark Streaming原生地支持多种数据源的接入,而且可以与Spark MLLib、Graphx结合起来使用。数据可以从Kafka、flume、Twitter、zeroMQ、Kinesis或者TCP的端口引入,同时能够被类似于使用map、reduce、join和window这种高级函数的算法所处理,最终,被处理过的数据能够被推送到磁盘、数据库。

简而言之,Spark Streaming的作用就是实时的将不同的数据源的数据经过处理之后将结果输出到外部文件系统。

Spark Streaming工作原理

从粗粒度来说,Spark Streaming接收到实时数据流,把数据按照指定的时间段切成一片片小的数据块,然后把小的数据块传给Spark Engine处理。

从细粒度来说,Spark Streaming接收实时输入数据流,然后将数据拆分成多个batch,比如每收集1秒的数据封装为一个batch,然后将每个batch交给Spark的计算引擎进行处理,最后会生产出一个结果数据流,其中的数据,也是由一个一个的batch所组成的。

Spark Streaming运行机制

Spark Streaming提供了一种高级的抽象,叫做DStream,它代表了一个持续不断的数据流。DStream可以通过输入数据源来创建,比如Kafka、Flume、ZMQ和Kinesis;也可以通过对其他DStream应用高阶函数来创建,比如map、reduce、join、window。

DStream的内部,其实是一系列持续不断产生的RDD。RDD是Spark Core的核心抽象,即不可变的,分布式的数据集。DStream中的每个RDD都包含了一个时间段内的数据。

对DStream应用的算子,比如map,其实在底层会被翻译为对DStream中每个RDD的操作。比如对一个DStream执行一个map操作,会产生一个新的DStream。但是,在底层,其实其原理为,对输入DStream中每个时间段的RDD,都应用一遍map操作,然后生成的新的RDD,即作为新的DStream中的那个时间段的一个RDD。

底层的RDD的transformation操作,还是由Spark Core的计算引擎来实现的。Spark Streaming对Spark Core进行了一层封装,隐藏了细节,然后对开发人员提供了方便易用的高层次的API。

Spark Streaming算子关系:

1) Spark Streaming 算子分为Transformation和Output

2) Transformation包括Spark中的Transform和部分的Action(Reduce、Count等)

3) Output:

• saveAsObjectFile、saveAsTextFile、saveAsHadoopFiles:将一批数据输出到Hadoop文件系统中,用批量数据的开始时间戳来命名

• forEachRDD:允许用户对DStream的每一批量数据对应的RDD本身做任意操作

关于大数据培训,Spark Streaming核心原理,以上就为大家做了简单的介绍了。Spark Streaming在企业级数据处理上的表现,至今仍然值得称赞,也是大数据开发者们需要去搞清楚弄明白的重要框架组件。成都加米谷大数据,专业大数据培训机构,大数据开发,数据分析与挖掘,本月正在招生中,课程大纲及试学视频,可联系客服领取!